На букву И Со слова «интеллектуальный»

Фраза «интеллектуальный агент»

Фраза состоит из двух слов и 21 букв без пробелов.

- Синонимы к фразе

- Написание фразы наоборот

- Написание фразы в транслите

- Написание фразы шрифтом Брайля

- Передача фразы на азбуке Морзе

- Произношение фразы на дактильной азбуке

- Остальные фразы со слова «интеллектуальный»

- Остальные фразы из 2 слов

Черное море. 3 серия (2020) Остросюжетный шпионский сериал @ Россия 1

Черное море. 1 серия (2020) Остросюжетный шпионский сериал @ Россия 1

Интеллектуальные агенты — Константин Яковлев

Интеллектуальные агенты

Разработка и внедрение интеллектуальных агентов / Андрей Иванов (Тинькофф)

Черное море. 2 серия (2020) Остросюжетный шпионский сериал @ Россия 1

Синонимы к фразе «интеллектуальный агент»

Какие близкие по смыслу слова и фразы, а также похожие выражения существуют. Как можно написать по-другому или сказать другими словами.

Фразы

- + анализ требований −

- + аппаратная платформа −

- + входные параметры −

- + задача классификации −

- + закон необходимого разнообразия −

- + имитационное моделирование −

- + интеллектуальный агент −

- + модульное обучение −

- + общий случай −

- + правовая коммуникация −

- + предметная область −

- + представление знаний −

- + программный агент −

- + семантическая сеть −

- + сервер базы данных −

- + синтез речи −

- + смешанная реальность −

- + структура объекта −

- + теория массового обслуживания −

- + упорядоченное множество −

- + управление стоимостью бизнеса −

- + уровень приложения −

- + физический канал −

- + эволюционные алгоритмы −

Ваш синоним добавлен!

Написание фразы «интеллектуальный агент» наоборот

Как эта фраза пишется в обратной последовательности.

тнега йыньлауткеллетни 😀

Написание фразы «интеллектуальный агент» в транслите

Как эта фраза пишется в транслитерации.

в армянской🇦🇲 ինտելլեկտուալնըյ ագենտ

в латинской🇬🇧 intellektualny agent

Как эта фраза пишется в пьюникоде — Punycode, ACE-последовательность IDN

xn--80ajakiefadnh6cfo7joa xn--80agg6aza

Как эта фраза пишется в английской Qwerty-раскладке клавиатуры.

byntkktrnefkmysqfutyn

Написание фразы «интеллектуальный агент» шрифтом Брайля

Как эта фраза пишется рельефно-точечным тактильным шрифтом.

⠊⠝⠞⠑⠇⠇⠑⠅⠞⠥⠁⠇⠾⠝⠮⠯⠀⠁⠛⠑⠝⠞

Передача фразы «интеллектуальный агент» на азбуке Морзе

Как эта фраза передаётся на морзянке.

⋅ ⋅ – ⋅ – ⋅ ⋅ – ⋅ ⋅ ⋅ – ⋅ ⋅ ⋅ – ⋅ – – ⋅ ⋅ – ⋅ – ⋅ – ⋅ ⋅ – ⋅ ⋅ – – ⋅ – ⋅ – – ⋅ – – – ⋅ – – – ⋅ ⋅ – ⋅ –

Произношение фразы «интеллектуальный агент» на дактильной азбуке

Как эта фраза произносится на ручной азбуке глухонемых (но не на языке жестов).

Передача фразы «интеллектуальный агент» семафорной азбукой

Как эта фраза передаётся флажковой сигнализацией.

Остальные фразы со слова «интеллектуальный»

Какие ещё фразы начинаются с этого слова.

- интеллектуальный акт

- интеллектуальный анализ

- интеллектуальный анализ текста

- интеллектуальный багаж

- интеллектуальный бестселлер

- интеллектуальный взрыв

- интеллектуальный дефект

- интеллектуальный индекс

- интеллектуальный капитал

- интеллектуальный капитал предпринимателя

- интеллектуальный класс

- интеллектуальный коэффициент

- интеллектуальный мир

- интеллектуальный план

- интеллектуальный подход

- интеллектуальный потенциал

- интеллектуальный потенциал общества

- интеллектуальный прогресс

- интеллектуальный продукт

- интеллектуальный прорыв

- интеллектуальный рост

- интеллектуальный сбыт

- интеллектуальный сноб

- интеллектуальный счётчик

Ваша фраза добавлена!

Остальные фразы из 2 слов

Какие ещё фразы состоят из такого же количества слов.

- а вдобавок

- а вдруг

- а ведь

- а вот

- а если

- а ещё

- а именно

- а капелла

- а каторга

- а ну-ка

- а приятно

- а также

- а там

- а то

- аа говорит

- аа отвечает

- аа рассказывает

- ааронов жезл

- аароново благословение

- аароново согласие

- аб ово

- абажур лампы

- абазинская аристократия

- абазинская литература

Комментарии

15:15

Что значит фраза «интеллектуальный агент»? Как это понять?..

Ответить

05:01

×

Здравствуйте!

У вас есть вопрос или вам нужна помощь?

Спасибо, ваш вопрос принят.

Ответ на него появится на сайте в ближайшее время.

А Б В Г Д Е Ё Ж З И Й К Л М Н О П Р С Т У Ф Х Ц Ч Ш Щ Ъ Ы Ь Э Ю Я

Транслит Пьюникод Шрифт Брайля Азбука Морзе Дактильная азбука Семафорная азбука

Палиндромы Сантана

Народный словарь великого и могучего живого великорусского языка.

Онлайн-словарь слов и выражений русского языка. Ассоциации к словам, синонимы слов, сочетаемость фраз. Морфологический разбор: склонение существительных и прилагательных, а также спряжение глаголов. Морфемный разбор по составу словоформ.

По всем вопросам просьба обращаться в письмошную.

In artificial intelligence, an intelligent agent (IA) is an agent acting in an intelligent manner; It perceives its environment, takes actions autonomously in order to achieve goals, and may improve its performance with learning or acquiring knowledge. An intelligent agent may be simple or complex: A thermostat or other control system is considered an example of an intelligent agent, as is a human being, as is any system that meets the definition, such as a firm, a state, or a biome.[1]

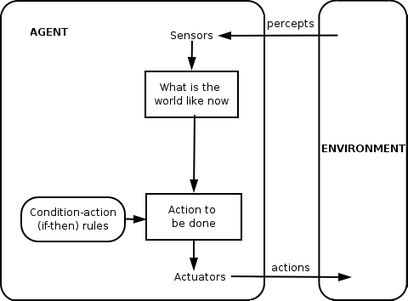

Simple reflex agent diagram

Leading AI textbooks define «artificial intelligence» as the «study and design of intelligent agents», a definition that considers goal-directed behavior to be the essence of intelligence. Goal-directed agents are also described using a term borrowed from economics, «rational agent».[1]

An agent has an «objective function» that encapsulates all the IA’s goals. Such an agent is designed to create and execute whatever plan will, upon completion, maximize the expected value of the objective function.[2] For example, a reinforcement learning agent has a «reward function» that allows the programmers to shape the IA’s desired behavior,[3] and an evolutionary algorithm’s behavior is shaped by a «fitness function».[4]

Intelligent agents in artificial intelligence are closely related to agents in economics, and versions of the intelligent agent paradigm are studied in cognitive science, ethics, the philosophy of practical reason, as well as in many interdisciplinary socio-cognitive modeling and computer social simulations.

Intelligent agents are often described schematically as an abstract functional system similar to a computer program. Abstract descriptions of intelligent agents are called abstract intelligent agents (AIA) to distinguish them from their real-world implementations. An autonomous intelligent agent is designed to function in the absence of human intervention. Intelligent agents are also closely related to software agents (an autonomous computer program that carries out tasks on behalf of users).

As a definition of artificial intelligence[edit]

Artificial Intelligence: A Modern Approach[5][6][2] defines an «agent» as

Anything that can be viewed as perceiving its environment through sensors and acting upon that environment through actuators,

defines a «rational agent» as:

An agent that acts so as to maximize the expected value of a performance measure based on past experience and knowledge.

and defines the field of «artificial intelligence» research as:

The study and design of rational agents

Padgham & Winikoff (2005) agree that an intelligent agent is situated in an environment and responds in a timely (though not necessarily real-time) manner to environment changes. However, intelligent agents must also proactively pursue goals in a flexible and robust way.[a] Optional desiderata include that the agent be rational, and that the agent be capable of belief-desire-intention analysis.[7]

Kaplan and Haenlein define artificial intelligence as «A system’s ability to correctly interpret external data, to learn from such data, and to use those learnings to achieve specific goals and tasks through flexible adaptation.»[8] This definition is closely related to that of an intelligent agent.

Advantages[edit]

Philosophically, this definition of artificial intelligence avoids several lines of criticism. Unlike the Turing test, it does not refer to human intelligence in any way. Thus, there is no need to discuss if it is «real» vs «simulated» intelligence (i.e., «synthetic» vs «artificial» intelligence) and does not indicate that such a machine has a mind, consciousness or true understanding (i.e., it does not imply John Searle’s «strong AI hypothesis»). It also doesn’t attempt to draw a sharp dividing line between behaviors that are «intelligent» and behaviors that are «unintelligent»—programs need only be measured in terms of their objective function.

More importantly, it has a number of practical advantages that have helped move AI research forward. It provides a reliable and scientific way to test programs; researchers can directly compare or even combine different approaches to isolated problems, by asking which agent is best at maximizing a given «goal function». It also gives them a common language to communicate with other fields—such as mathematical optimization (which is defined in terms of «goals») or economics (which uses the same definition of a «rational agent»).[9]

Objective function[edit]

An agent that is assigned an explicit «goal function» is considered more intelligent if it consistently takes actions that successfully maximize its programmed goal function. The goal can be simple («1 if the IA wins a game of Go, 0 otherwise») or complex («Perform actions mathematically similar to ones that succeeded in the past»). The «goal function» encapsulates all of the goals the agent is driven to act on; in the case of rational agents, the function also encapsulates the acceptable trade-offs between accomplishing conflicting goals. (Terminology varies; for example, some agents seek to maximize or minimize a «utility function», «objective function», or «loss function».)[6][2]

Goals can be explicitly defined or induced. If the AI is programmed for «reinforcement learning», it has a «reward function» that encourages some types of behavior and punishes others. Alternatively, an evolutionary system can induce goals by using a «fitness function» to mutate and preferentially replicate high-scoring AI systems, similar to how animals evolved to innately desire certain goals such as finding food.[10] Some AI systems, such as nearest-neighbor, instead of reason by analogy, these systems are not generally given goals, except to the degree that goals are implicit in their training data.[11] Such systems can still be benchmarked if the non-goal system is framed as a system whose «goal» is to accomplish its narrow classification task.[12]

Systems that are not traditionally considered agents, such as knowledge-representation systems, are sometimes subsumed into the paradigm by framing them as agents that have a goal of (for example) answering questions as accurately as possible; the concept of an «action» is here extended to encompass the «act» of giving an answer to a question. As an additional extension, mimicry-driven systems can be framed as agents who are optimizing a «goal function» based on how closely the IA succeeds in mimicking the desired behavior.[6][2] In the generative adversarial networks of the 2010s, an «encoder»/»generator» component attempts to mimic and improvise human text composition. The generator is attempting to maximize a function encapsulating how well it can fool an antagonistic «predictor»/»discriminator» component.[13]

While GOFAI systems often accept an explicit goal function, the paradigm can also be applied to neural networks and to evolutionary computing. Reinforcement learning can generate intelligent agents that appear to act in ways intended to maximize a «reward function».[14] Sometimes, rather than setting the reward function to be directly equal to the desired benchmark evaluation function, machine learning programmers will use reward shaping to initially give the machine rewards for incremental progress in learning.[15] Yann LeCun stated in 2018 that «Most of the learning algorithms that people have come up with essentially consist of minimizing some objective function.»[16] AlphaZero chess had a simple objective function; each win counted as +1 point, and each loss counted as -1 point. An objective function for a self-driving car would have to be more complicated.[17] Evolutionary computing can evolve intelligent agents that appear to act in ways intended to maximize a «fitness function» that influences how many descendants each agent is allowed to leave.[4]

The theoretical and uncomputable AIXI design is a maximally intelligent agent in this paradigm;[18] however, in the real world, the IA is constrained by finite time and hardware resources, and scientists compete to produce algorithms that can achieve progressively higher scores on benchmark tests with real-world hardware.[19][relevant?]

Classes of intelligent agents[edit]

Russel and Norvig’s classification[edit]

Russell & Norvig (2003) group agents into five classes based on their degree of perceived intelligence and capability:[20]

Simple reflex agents[edit]

Simple reflex agents act only on the basis of the current percept, ignoring the rest of the percept history. The agent function is based on the condition-action rule: «if condition, then action».

This agent function only succeeds when the environment is fully observable. Some reflex agents can also contain information on their current state which allows them to disregard conditions whose actuators are already triggered.

Infinite loops are often unavoidable for simple reflex agents operating in partially observable environments. If the agent can randomize its actions, it may be possible to escape from infinite loops.

Model-based reflex agents[edit]

A model-based agent can handle partially observable environments. Its current state is stored inside the agent maintaining some kind of structure that describes the part of the world which cannot be seen. This knowledge about «how the world works» is called a model of the world, hence the name «model-based agent».

A model-based reflex agent should maintain some sort of internal model that depends on the percept history and thereby reflects at least some of the unobserved aspects of the current state. Percept history and impact of action on the environment can be determined by using the internal model. It then chooses an action in the same way as reflex agent.

An agent may also use models to describe and predict the behaviors of other agents in the environment.[21]

Goal-based agents[edit]

Model-based, goal-based agent

Goal-based agents further expand on the capabilities of the model-based agents, by using «goal» information. Goal information describes situations that are desirable. This provides the agent a way to choose among multiple possibilities, selecting the one which reaches a goal state. Search and planning are the subfields of artificial intelligence devoted to finding action sequences that achieve the agent’s goals.

Utility-based agents[edit]

Model-based, utility-based agent

Goal-based agents only distinguish between goal states and non-goal states. It is also possible to define a measure of how desirable a particular state is. This measure can be obtained through the use of a utility function which maps a state to a measure of the utility of the state. A more general performance measure should allow a comparison of different world states according to how well they satisfied the agent’s goals. The term utility can be used to describe how «happy» the agent is.

A rational utility-based agent chooses the action that maximizes the expected utility of the action outcomes — that is, what the agent expects to derive, on average, given the probabilities and utilities of each outcome. A utility-based agent has to model and keep track of its environment, tasks that have involved a great deal of research on perception, representation, reasoning, and learning.

Learning agents[edit]

Learning has the advantage that it allows the agents to initially operate in unknown environments and to become more competent than its initial knowledge alone might allow. The most important distinction is between the «learning element», which is responsible for making improvements, and the «performance element», which is responsible for selecting external actions.

The learning element uses feedback from the «critic» on how the agent is doing and determines how the performance element, or «actor», should be modified to do better in the future. The performance element is what we have previously considered to be the entire agent: it takes in percepts and decides on actions.

The last component of the learning agent is the «problem generator». It is responsible for suggesting actions that will lead to new and informative experiences.

Weiss’s classification[edit]

Weiss (2013) defines four classes of agents:

- Logic-based agents – in which the decision about what action to perform is made via logical deduction.

- Reactive agents – in which decision making is implemented in some form of direct mapping from situation to action.

- Belief-desire-intention agents – in which decision making depends upon the manipulation of data structures representing the beliefs, desires, and intentions of the agent; and finally,

- Layered architectures – in which decision making is realized via various software layers, each of which is more or less explicitly reasoning about the environment at different levels of abstraction.

Other[edit]

In 2013, Alexander Wissner-Gross published a theory pertaining to Freedom and Intelligence for intelligent agents.[22][23]

Hierarchies of agents[edit]

To actively perform their functions, Intelligent Agents today are normally gathered in a hierarchical structure containing many “sub-agents”. Intelligent sub-agents process and perform lower-level functions. Taken together, the intelligent agent and sub-agents create a complete system that can accomplish difficult tasks or goals with behaviors and responses that display a form of intelligence.

Generally, an agent can be constructed by separating the body into the sensors and actuators, and so that it operates with a complex perception system that takes the description of the world as input for a controller and outputs commands to the actuator. However, a hierarchy of controller layers is often necessary to balance the immediate reaction desired for low-level tasks and the slow reasoning about complex, high-level goals.[24]

Agent function[edit]

A simple agent program can be defined mathematically as a function f (called the «agent function»)[25] which maps every possible percepts sequence to a possible action the agent can perform or to a coefficient, feedback element, function or constant that affects eventual actions:

Agent function is an abstract concept as it could incorporate various principles of decision making like calculation of utility of individual options, deduction over logic rules, fuzzy logic, etc.[26]

The program agent, instead, maps every possible percept to an action.[27]

We use the term percept to refer to the agent’s perceptional inputs at any given instant. In the following figures, an agent is anything that can be viewed as perceiving its environment through sensors and acting upon that environment through actuators.

Applications[edit]

Intelligent agents are applied as automated online assistants, where they function to perceive the needs of customers in order to perform individualized customer service. Such an agent may basically consist of a dialog system, an avatar, as well an expert system to provide specific expertise to the user.[citation needed] They can also be used to optimize coordination of human groups online.[28] Hallerbach et al. discussed the application of agent-based approaches for the development and validation of automated driving systems via a digital twin of the vehicle-under-test and microscopic traffic simulation based on independent agents.[29] Waymo has created a multi-agent simulation environment Carcraft to test algorithms for self-driving cars.[30][31] It simulates traffic interactions between human drivers, pedestrians and automated vehicles. People’s behavior is imitated by artificial agents based on data of real human behavior. The basic idea of using agent-based modeling to understand self-driving cars was discussed as early as 2003.[32]

Alternative definitions and uses[edit]

«Intelligent agent» is also often used as a vague marketing term, sometimes synonymous with «virtual personal assistant».[33] Some 20th-century definitions characterize an agent as a program that aids a user or that acts on behalf of a user.[34] These examples are known as software agents, and sometimes an «intelligent software agent» (that is, a software agent with intelligence) is referred to as an «intelligent agent».

According to Nikola Kasabov, IA systems should exhibit the following characteristics:[35]

- Accommodate new problem solving rules incrementally

- Adapt online and in real time

- Are able to analyze themselves in terms of behavior, error and success.

- Learn and improve through interaction with the environment (embodiment)

- Learn quickly from large amounts of data

- Have memory-based exemplar storage and retrieval capacities

- Have parameters to represent short- and long-term memory, age, forgetting, etc.

See also[edit]

- Ambient intelligence

- Artificial intelligence systems integration

- Autonomous agent

- Cognitive architectures

- Cognitive radio – a practical field for implementation

- Cybernetics

- DAYDREAMER

- Embodied agent

- Federated search – the ability for agents to search heterogeneous data sources using a single vocabulary

- Friendly artificial intelligence

- Fuzzy agents – IA implemented with adaptive fuzzy logic

- GOAL agent programming language

- Hybrid intelligent system

- Intelligent control

- Intelligent system

- JACK Intelligent Agents

- Multi-agent system and multiple-agent system – multiple interactive agents

- Reinforcement learning

- Semantic Web – making data on the Web available for automated processing by agents

- Social simulation

- Software agent

- Software bot

Notes[edit]

- ^ The Padgham & Winikoff definition explicitly covers only social agents that interact with other agents.

Inline references[edit]

- ^ a b Russell & Norvig 2003, chpt. 2.

- ^ a b c d Bringsjord, Selmer; Govindarajulu, Naveen Sundar (12 July 2018). «Artificial Intelligence». In Edward N. Zalta (ed.). The Stanford Encyclopedia of Philosophy (Summer 2020 Edition).

- ^ Wolchover, Natalie (30 January 2020). «Artificial Intelligence Will Do What We Ask. That’s a Problem». Quanta Magazine. Retrieved 21 June 2020.

- ^ a b Bull, Larry (1999). «On model-based evolutionary computation». Soft Computing. 3 (2): 76–82. doi:10.1007/s005000050055. S2CID 9699920.

- ^ Russell & Norvig 2003, pp. 4–5, 32, 35, 36 and 56.

- ^ a b c Russell & Norvig (2003)

- ^ Lin Padgham and Michael Winikoff. Developing intelligent agent systems: A practical guide. Vol. 13. John Wiley & Sons, 2005.

- ^ Kaplan, Andreas; Haenlein, Michael (1 January 2019). «Siri, Siri, in my hand: Who’s the fairest in the land? On the interpretations, illustrations, and implications of artificial intelligence». Business Horizons. 62 (1): 15–25. doi:10.1016/j.bushor.2018.08.004. S2CID 158433736.

- ^ Russell & Norvig 2003, p. 27.

- ^ Domingos 2015, Chapter 5.

- ^ Domingos 2015, Chapter 7.

- ^ Lindenbaum, M., Markovitch, S., & Rusakov, D. (2004). Selective sampling for nearest neighbor classifiers. Machine learning, 54(2), 125–152.

- ^ «Generative adversarial networks: What GANs are and how they’ve evolved». VentureBeat. 26 December 2019. Retrieved 18 June 2020.

- ^ Wolchover, Natalie (January 2020). «Artificial Intelligence Will Do What We Ask. That’s a Problem». Quanta Magazine. Retrieved 18 June 2020.

- ^ Andrew Y. Ng, Daishi Harada, and Stuart Russell. «Policy invariance under reward transformations: Theory and application to reward shaping.» In ICML, vol. 99, pp. 278-287. 1999.

- ^ Martin Ford. Architects of Intelligence: The truth about AI from the people building it. Packt Publishing Ltd, 2018.

- ^ «Why AlphaZero’s Artificial Intelligence Has Trouble With the Real World». Quanta Magazine. 2018. Retrieved 18 June 2020.

- ^ Adams, Sam; Arel, Itmar; Bach, Joscha; Coop, Robert; Furlan, Rod; Goertzel, Ben; Hall, J. Storrs; Samsonovich, Alexei; Scheutz, Matthias; Schlesinger, Matthew; Shapiro, Stuart C.; Sowa, John (15 March 2012). «Mapping the Landscape of Human-Level Artificial General Intelligence». AI Magazine. 33 (1): 25. doi:10.1609/aimag.v33i1.2322.

- ^ Hutson, Matthew (27 May 2020). «Eye-catching advances in some AI fields are not real». Science | AAAS. Retrieved 18 June 2020.

- ^ Russell & Norvig 2003, pp. 46–54

- ^ Stefano Albrecht and Peter Stone (2018). Autonomous Agents Modelling Other Agents: A Comprehensive Survey and Open Problems.

Artificial Intelligence, Vol. 258, pp. 66-95. https://doi.org/10.1016/j.artint.2018.01.002 - ^ Box, Geeks out of the (2019-12-04). «A Universal Formula for Intelligence». Geeks out of the box. Retrieved 2022-10-11.

- ^ Wissner-Gross, A. D.; Freer, C. E. (2013-04-19). «Causal Entropic Forces». Physical Review Letters. 110 (16): 168702. Bibcode:2013PhRvL.110p8702W. doi:10.1103/PhysRevLett.110.168702. PMID 23679649.

- ^ Poole, David; Mackworth, Alan. «1.3 Agents Situated in Environments‣ Chapter 2 Agent Architectures and Hierarchical Control‣ Artificial Intelligence: Foundations of Computational Agents, 2nd Edition». artint.info. Retrieved 28 November 2018.

- ^ Russell & Norvig 2003, p. 33

- ^ Salamon, Tomas (2011). Design of Agent-Based Models. Repin: Bruckner Publishing. pp. 42–59. ISBN 978-80-904661-1-1.

- ^ Nilsson, Nils J. (April 1996). «Artificial intelligence: A modern approach». Artificial Intelligence. 82 (1–2): 369–380. doi:10.1016/0004-3702(96)00007-0. ISSN 0004-3702.

- ^ Shirado, Hirokazu; Christakis, Nicholas A (2017). «Locally noisy autonomous agents improve global human coordination in network experiments». Nature. 545 (7654): 370–374. Bibcode:2017Natur.545..370S. doi:10.1038/nature22332. PMC 5912653. PMID 28516927.

- ^ Hallerbach, S.; Xia, Y.; Eberle, U.; Koester, F. (2018). «Simulation-Based Identification of Critical Scenarios for Cooperative and Automated Vehicles». SAE International Journal of Connected and Automated Vehicles. SAE International. 1 (2): 93. doi:10.4271/2018-01-1066.

- ^ Madrigal, Story by Alexis C. «Inside Waymo’s Secret World for Training Self-Driving Cars». The Atlantic. Retrieved 14 August 2020.

- ^ Connors, J.; Graham, S.; Mailloux, L. (2018). «Cyber Synthetic Modeling for Vehicle-to-Vehicle Applications». In International Conference on Cyber Warfare and Security. Academic Conferences International Limited: 594-XI.

- ^ Yang, Guoqing; Wu, Zhaohui; Li, Xiumei; Chen, Wei (2003). «SVE: embedded agent based smart vehicle environment». Proceedings of the 2003 IEEE International Conference on Intelligent Transportation Systems. Vol. 2. pp. 1745–1749. doi:10.1109/ITSC.2003.1252782. ISBN 0-7803-8125-4. S2CID 110177067.

- ^ Fingar, Peter (2018). «Competing For The Future With Intelligent Agents… And A Confession». Forbes Sites. Retrieved 18 June 2020.

- ^ Burgin, Mark, and Gordana Dodig-Crnkovic. «A systematic approach to artificial agents.» arXiv preprint arXiv:0902.3513 (2009).

- ^ Kasabov 1998.

Other references[edit]

- Domingos, Pedro (September 22, 2015). The Master Algorithm: How the Quest for the Ultimate Learning Machine Will Remake Our World. Basic Books. ISBN 978-0465065707.

- Russell, Stuart J.; Norvig, Peter (2003). Artificial Intelligence: A Modern Approach (2nd ed.). Upper Saddle River, New Jersey: Prentice Hall. Chapter 2. ISBN 0-13-790395-2.

- Kasabov, N. (1998). «Introduction: Hybrid intelligent adaptive systems». International Journal of Intelligent Systems. 13 (6): 453–454. doi:10.1002/(SICI)1098-111X(199806)13:6<453::AID-INT1>3.0.CO;2-K. S2CID 120318478.

- Weiss, G. (2013). Multiagent systems (2nd ed.). Cambridge, MA: MIT Press. ISBN 978-0-262-01889-0.

External links[edit]

- Coneural

Home > Terms > Русский (RU) > Интеллектуальный агент

Интеллектуальный агент

1. в Интернете, интеллектуальный поиск инструмент, который автоматически ищет соответствующую онлайн информацию, основанную на спецификациях пользователя. Синонимы агент, скрипт, гусеничные, hotbot, infobot, информация агента, умный агент, Интернет поисковой системы, knowbot, знаний робот, личный агент, Роботизированная библиотекарь, поисковый робот, паук, веб-сканера, веб-паук, мастера. 2. в области искусственного интеллекта, сущность с возможностью ощутить ее окружающей среды и действовать таким образом или для изменения этой среды; обычно на основе знаний сущности, которые могут общаться друг с другом через некоторые схемы передачи сообщений.

Эта информация была сгенерирована автоматически. Вы можете помочь нам улучшить ее.

- Часть речи: имя существительное

- Синоним(ы):

- Словарь:

- Отрасль/сфера деятельности: Телекоммуникации

- Категория: Общие термины по телекоммуникациям

- Company: ATIS

- Продукт:

- Акроним-сокращение:

Выбрать другой язык:

Термины в новостях

Билли Морган

Спорт; Сноубординг

Британский сноубордист Билли Морган приземлился первый когда-либо 1800 Четырехместный Корк спорта. Всадника, который представлял Великобритания на зимних Олимпийских играх 2014 года в Сочи, был в Ливиньо, Италия, когда он достиг маневр. Он включает в себя листать четыре раза, в то время как тело также спины пять полная поворотов на оси, боковое или лицевой стороной …

Марзии Afkham

Телерадиовещание и теле и радиоприем; Новости

Afkham Марзии, который первый представитель министерства иностранных дел страны, будет возглавлять миссии в Восточной Азии, сообщило Государственное информационное агентство. Это не ясно в какую страну она будут размещены как ее назначения еще не объявлено официально.

Afkham будет только второй женский посол, Иран имеет. Под правило последнего …

За пакет

Язык; Услуги в режиме онлайн; Сленг; Интернет

Еженедельно пакет или «Paquete участие» как известно, на Кубе является термин используется для описания сведений, собранных из Интернет вне куба кубинцы и сохранены на жесткие диски к перевозке на самой Кубе. За пакеты затем продаются кубинца без доступа к Интернету, что позволяет им получать информацию через несколько дней — и иногда часов — после того, как она …

Спартанский

Услуги в режиме онлайн; Интернет

Спартанец является кодовым именем для новый браузер Microsoft Windows 10, который будет заменить Microsoft Windows Internet Explorer.

Новый браузер будет построено от земли и игнорирование любого кода от платформы IE. Она имеет новый движок рендеринга, которая построена, чтобы быть совместимым с как веб написано сегодня.

Имя …

Особые термины

Веймаранер

Крупная порода охотничьих собак, которая происходит из Германии. Имеет гладкую сероватого цвета шерсть.

Участник

Избранные глоссарии

Browers Terms By Category

- Зоологические термины(611)

- Глаголы, производные от названий животных(25)

Зоология(636) Terms

- Символы(952)

- Рукопашные игры(83)

- Стрелялки(77)

- Общие термины по играм(72)

- Многопользовательские онлайн-игры(70)

- Музыкальные игры(62)

Видеоигры(1405) Terms

- Юридическая документация(5)

- Технические публикации(1)

- Маркетинговая документация(1)

Документы(7) Terms

- Aeronautics(5992)

- Управление воздушным движением(1257)

- Аэропорт(1242)

- Летательные аппараты(949)

- Aircraft maintenance(888)

- Powerplant(616)

Авиация(12294) Terms

- Реки(1036)

- Озера(494)

- Bays(192)

- Ледники(107)

- Океаны(67)

- Моря(60)

Водоемы(2001) Terms

Обычный агент

Обучающийся агент

Термины «агент» и «интеллектуальный агент» (ИА) имеют два значения, и из-за этого иногда возникает путаница.

В компьютерной науке интеллектуальный агент — программа, самостоятельно выполняющая задание, указанное пользователем компьютера, в течение длительных промежутков времени. Интеллектуальные агенты используются для содействия оператору или сбора информации. Одним из примеров заданий, выполняемых агентами, может служить задача постоянного поиска и сбора необходимой информации в Интернете. Компьютерные вирусы, боты, поисковые роботы — всё это также можно отнести к интеллектуальным агентам. Хотя такие агенты имеют строгий алгоритм, «интеллектуальность» в этом контексте понимается как способность приспосабливаться и обучаться.

В искусственном интеллекте, под термином интеллектуальный агент понимаются разумные сущности, наблюдающие за окружающей средой и действующие в ней, при этом их поведение рационально в том смысле, что они способны к пониманию и их действия всегда направлены на достижение какой-либо цели. Такой агент может быть как роботом, так и встроенной программной системой. Об интеллектуальности агента можно говорить, если он взаимодействует с окружающей средой примерно так же, как действовал бы человек.

Эти два значения понятия «интеллектуальный агент» достаточно различны, и между ними почти нет связи. Интеллектуальный агент в первом смысле может быть разработан, используя традиционные методы разработки, в нём немногим больше интеллекта, чем в почтовом клиенте или утилите для форматирования жёсткого диска. Однако интеллектуальный агент во втором смысле может быть полностью независимым, выполняя свои задачи.

В операционных системах семейства UNIX интеллектуальный агент, действующий в пределах одного компьютера или локальной сети, обычно называется демоном, в семействе Windows — службой (сервисом). Пример: cron в UNIX и «Планировщик задач» в Windows занимаются тем, что запускают указанные пользователем задания в определённые моменты времени.

Содержание

- 1 Интеллектуальные агенты в искусственном интеллекте

- 1.1 Агенты с простым поведением

- 1.2 Агенты с поведением, основанным на модели

- 1.3 Целенаправленные агенты

- 1.4 Практичные агенты

- 1.5 Обучающиеся агенты

- 2 Субагенты

- 3 Интеллектуальные агенты в компьютерной науке

- 3.1 Роботы по закупкам

- 3.2 Пользовательские или персональные агенты

- 3.3 Управляющие и наблюдающие агенты

- 3.4 Добывающие информацию агенты

- 4 См. также

- 5 Литература

- 6 Ссылки

Интеллектуальные агенты в искусственном интеллекте

В искусственном интеллекте существует несколько типов агентов. Например:

- Физический Агент — агент, воспринимающий окружающий мир через некоторые сенсоры и действующий с помощью манипуляторов.

- Временной агент — агент, использующий изменяющуюся с ходом времени информацию и предлагающий некоторые действия или предоставляющий данные компьютерной программе или человеку, и получающий информацию через программный ввод.

Простая агентная программа может быть математически описана как агентская функция, которая проектирует любой подходящий результат восприятия на действие, которое агент может выполнить, или в коэффициент, элемент обратной связи, функцию или константу, которые могут повлиять на дальнейшие действия.

Программный агент, напротив, проецирует результат восприятия только на действие.

Всех агентов можно разделить на пять групп, по типу обработки воспринимаемой информации:

- Агенты с простым поведением.

- Агенты с поведением, основанным на модели.

- Целенаправленные агенты.

- Практичные агенты.

- Обучающиеся агенты.

Агенты с простым поведением

Агенты с простым поведением действуют только на основе текущих знаний. Их агентская функция основана на схеме условие-действие

IF (условие) THEN действие

Такая функция может быть успешной, только если окружающая среда полностью поддается наблюдению. Некоторые агенты также могут иметь информацию о их текущем состоянии, что позволяет им не обращать внимания на условия, предпосылки которых уже выполнены.

Агенты с поведением, основанным на модели

Агенты с поведением, основанным на модели, могут оперировать со средой, лишь частично поддающейся наблюдению. Внутри агента хранится представление о той части, что находится вне границ обзора. Чтобы иметь такое представление, агенту необходимо знать, как выглядит окружающий мир, как он устроен. Эта дополнительная информация дополняет «Картину Мира».

Целенаправленные агенты

Целенаправленные агенты схожи с предыдущим типом, однако они, помимо прочего, хранят информацию о тех ситуациях, которые для них желательны. Это дает агенту способ выбрать среди многих путей тот, что приведет к нужной цели.

Практичные агенты

Целенаправленные агенты различают только состояния, когда цель достигнута, и когда не достигнута. Практичные агенты, помимо этого, способны различать, насколько желанно для них текущее состояние. Такая оценка может быть получена с помощью «функции полезности», которая проецирует множество состояний на множество мер полезности состояний.

Обучающиеся агенты

В некоторой литературе обучающиеся агенты (ОА) также называются автономными интеллектуальными агентами(англ. autonomous intelligent agents), что означает их независимость и способность к обучению и приспосабливанию к изменяющимся обстоятельствам. По мнению Николая Касабова[1],система ОА должна проявлять следующие способности:

- обучаться и развиваться в процессе взаимодействия с окружающей средой

- приспосабливаться в режиме реального времени

- быстро обучаться на основе большого объёма данных

- пошагово приспосабливать новые способы решения проблем

- обладать базой примеров с возможностью её пополнения

- иметь параметры для моделирования быстрой и долгой памяти, возраста и т. д.

- анализировать себя в терминах поведения, ошибки и успеха

Субагенты

Чтобы активно выполнять свои функции, интеллектуальные агенты обычно имеют иерархическую структуру, включающую много «субагентов». Интеллектуальные субагенты обрабатывают и выполняют низкоуровневые функции. Интеллектуальные агенты и субагенты составляют полную систему, которая способна выполнять сложные задачи. При этом поведение системы создаёт впечатление разумности.

Существует несколько типов субагентов:

- Временные агенты (для принятия оперативных решений)

- Пространственные клиенты (для взаимодействия с реальным миром)

- Сенсорные агенты (обрабатывают сенсорные сигналы — к примеру агенты, работающие на основе нейросети)

- Обрабатывающие агенты (решают проблемы типа распознавания речи)

- Принимающие решение агенты

- Обучающие агенты (для создания структур и баз данных для остальных интеллектуальных агентов)

- Мировые агенты (объединяют в себе остальные классы агентов для автономного поведения)

Интеллектуальные агенты в компьютерной науке

Достаточно ограниченное число агентов, которые могут считаться полуинтеллектуальными (из-за своей простоты, слабой способности к принятию решений, ограниченности взглядов на внешний мир и плохой обучаемости) перечислены в документе [2].

Согласно ему, существует только 4 типа таких ИА:

- Роботы по закупкам[2].

- Пользовательские или персональные агенты.

- Управляющие и наблюдающие агенты[2].

- Добывающие информацию агенты.

Роботы по закупкам

Такие роботы, просматривая сетевые ресурсы (чаще всего Интернет), собирают информацию о товарах и услугах. Роботы по закупкам очень эффективно работают с товарами народного потребления, такими как компакт-диски, книги, электротовары и другие товары. Amazon.com является отличным примером такого робота. Веб-сайт предложит вам список товаров, что вам могут быть интересны, основываясь на том, что вы покупали в прошлом.

Пользовательские или персональные агенты

Пользовательские агенты — это ИА, которые действуют в ваших интересах, от вашего имени. К этой категории относятся ИА, которые постоянно, или в течение некоторого времени выполняют следующие задания:

- проверяют вашу почту, сортируют их по важности (используя заданные вами критерии), и оповещают вас, когда поступает важное письмо, например, письмо о поступлении в университет;

- играют в компьютерной игре как ваш оппонент или патрулируют области в игре для помощи вам;

- собирают новости (существует несколько версий таких роботов, к примеру CNN);

- ищут информацию по выбранному предмету;

- самостоятельно заполняют web-формы, сохраняя информацию для последующего использования;

- просматривают веб-страницы, ища и подсвечивая ключевую информацию;

- «дискутирует» с вами на различные темы, от ваших страхов до спорта.

Управляющие и наблюдающие агенты

Управляющие агенты, также известные как «предсказывающие агенты» ведут наблюдение и отправляют отчеты. К примеру, в NASA’s Jet Propulsion Laboratory есть агент, следящий за состоянием инвентаря, планированием, составлением расписания. Такие агенты обычно ведут наблюдение за компьютерными сетями и следят за конфигурацией каждого компьютера, подключенного к сети.

Добывающие информацию агенты

Такие агенты действуют в хранилище данных, собирая информацию. Хранилище данных объединяет в себе информацию из разных источников. Сбор информации — это процесс поиска данных для последующего использования, например, для увеличения продаж или привлечения покупателей. ‘Классификация’ — один из наиболее часто используемых приемов для сбора информации, который находит и категоризирует образы в информации. Добывающие информацию агенты также могут обнаруживать ключевые изменения тенденций развития и предупредить вас о наличии новой информации.

См. также

- Искусственный интеллект

- Многоагентная система и Агентное моделирование — множество интерактивных агентов

- Обучение с подкреплением

- Semantic Web — приспособление информации в сети для автоматической обработки

Литература

- ↑ N. Kasabov, Introduction: Hybrid intelligent adaptive systems. International Journal of Intelligent Systems, Vol.6, (1998) 453—454.

- ↑ 1 2 3 Haag, Stephen. «Management Information Systems for the Information Age», 2006. Pages 224—228

- Y. Shoham, K. Leyton-Brown. Algorithmic, Game-Theoretic, and Logical Foundations. – London: Cambridge University Press, 2009

- Емельянов В.В., Курейчик В.В., Курейчик В.М. Теория и практика эволюционного моделирования. – М: ФИЗМАТЛИТ, 2003, — 432 с.

- М.Ейген, П. Шустер. Гиперцикл. Принципы организации макро-молекул.// Пер. д.б.н. В.М. Андреева. Ред. член-корр АН СССР М.В. Волькенштейна, проф. Д.С. Чернавский.

Ссылки

- Intelligent Agent — from MIT Encyclopedia (англ.)

- Bridgeport (англ.)

- Coneural (англ.)

| |

||

|---|---|---|

| Философия |

Тест Тьюринга • Китайская комната |

Портал |

| Направления |

Агентный подход • Адаптивное управление • Инженерия знаний • Модель жизнеспособной системы • Машинное обучение • Нейронные сети • Нечёткая логика • Обработка естественного языка • Распознавание образов • Роевой интеллект • Эволюционные алгоритмы • Экспертная система |

|

| Применение |

Голосовое управление • Задача классификации • Классификация документов • Кластеризация документов • Кластерный анализ • Локальный поиск • Машинный перевод • Оптическое распознавание символов • Распознавание речи • Распознавание рукописного ввода • Игровой ИИ |

|

| Исследователи |

Норберт Винер • Алан Тьюринг • В. М. Глушков • Г. С. Осипов • Д. Э. Попов • Д. А. Поспелов • М. Г. Гаазе-Рапопорт • Т. А. Гаврилова • В. Ф. Хорошевский • Г. С. Поспелов • Марвин Мински • Джон Маккарти • Фрэнк Розенблатт • Чарльз Бэббидж • Аллен Ньюэлл • Герберт Саймон • Ноам Хомский • Джуда Перл • Сеймур Паперт • Клод Шеннон • Джозеф Уайзенбаум • Патрик Винстон • В. К. Финн |

|

| Организации |

Государственный университет информатики и искусственного интеллекта • Singularity Institute for Artificial Intelligence |

В области искусственного интеллекта , интеллектуальный агент ( IA ) ничего , что воспринимает его окружение, принимает меры автономны для достижения целей, и может улучшить свою работу с обучения или использовать знание . Они могут быть простыми или сложными — термостат считается примером интеллектуального агента, как и человек, как и любая система, которая соответствует определению, например, фирма , государство или биом .

Схема простого рефлекторного агента

Ведущие учебники по искусственному интеллекту определяют «искусственный интеллект» как «изучение и создание интеллектуальных агентов», определение, которое рассматривает целенаправленное поведение как суть интеллекта. Агенты, направленные на достижение цели, также описываются с использованием термина, заимствованного из экономики , « рациональный агент ».

У агента есть «целевая функция», которая включает в себя все цели IA. Такой агент предназначен для создания и выполнения любого плана, который по завершении максимизирует ожидаемое значение целевой функции. Например, агент обучения с подкреплением имеет «функцию вознаграждения», которая позволяет программистам формировать желаемое поведение IA, а поведение эволюционного алгоритма формируется «функцией приспособленности».

Интеллектуальные агенты в искусственном интеллекте тесно связаны с агентами в экономике , и версии парадигмы интеллектуальных агентов изучаются в когнитивной науке , этике , философии практического разума , а также во многих междисциплинарных социально-когнитивных моделях и компьютерных социальных симуляциях .

Интеллектуальные агенты часто схематически описываются как абстрактная функциональная система, подобная компьютерной программе. Абстрактные описания интеллектуальных агентов называются абстрактными интеллектуальными агентами ( AIA ), чтобы отличать их от их реализаций в реальном мире. Автономный интеллектуальный агент предназначен для функции при отсутствии вмешательства человека. Интеллектуальные агенты также тесно связаны с программными агентами (автономная компьютерная программа, выполняющая задачи от имени пользователей).

Определение искусственного интеллекта

Информатика определяет исследование ИИ как исследование интеллектуальных агентов . Ведущий учебник AI

определяет «агент» , как:

- «Все, что можно рассматривать как воспринимающее окружающую среду с помощью датчиков и действующее на эту среду с помощью исполнительных механизмов»

определяет «рационального агента» как:

- «Агент, который действует так, чтобы максимизировать ожидаемую ценность показателя производительности, основанного на прошлом опыте и знаниях».

и определяет область исследований «искусственного интеллекта» как:

- «Исследование и конструирование рациональных агентов»

Аналогичное определение ИИ дано Капланом и Хэнлайном: «Способность системы правильно интерпретировать внешние данные, учиться на них и использовать полученные знания для достижения конкретных целей и задач посредством гибкой адаптации».

Пэдхэм и Виникофф (2005) соглашаются с тем, что интеллектуальный агент находится в среде и реагирует (своевременно, хотя и не обязательно в реальном времени) на изменения среды. Однако интеллектуальные агенты также должны активно и гибко преследовать цели. Необязательные пожелания включают, чтобы агент был рациональным и чтобы агент был способен анализировать убеждение-желание-намерение .

Преимущества этого определения

С философской точки зрения он избегает нескольких строк критики. В отличие от теста Тьюринга , он никоим образом не относится к человеческому интеллекту. Таким образом, нет необходимости обсуждать, является ли это «реальный» или «смоделированный» интеллект (т.е. «синтетический» или «искусственный» интеллект), и не указывает на то, что такая машина обладает разумом , сознанием или истинным пониманием (т. Е. это не подразумевает « сильную гипотезу ИИ » Джона Сирла ). Он также не пытается провести четкую границу между поведением, которое является «разумным», и поведением, которое является «неразумным» — программы нужно измерять только с точки зрения их целевой функции.

Что еще более важно, он имеет ряд практических преимуществ, которые помогли продвинуть исследования ИИ вперед. Он обеспечивает надежный и научный способ тестирования программ; исследователи могут напрямую сравнивать или даже комбинировать различные подходы к изолированным проблемам, задавая вопрос, какой агент лучше всего максимизирует данную «целевую функцию». Это также дает им общий язык для общения с другими областями, такими как математическая оптимизация (которая определяется в терминах «целей») или экономика (в которой используется то же определение « рационального агента »).

Целевая функция

Агент, которому назначена явная «целевая функция», считается более умным, если он последовательно предпринимает действия, которые успешно максимизируют его запрограммированную целевую функцию. Цель может быть простой («1, если IA выиграет игру в го , 0 в противном случае») или сложной («Выполнить действия, математически похожие на те, которые были успешными в прошлом»). «Целевая функция» включает в себя все цели, ради достижения которых агент стремится действовать; в случае рациональных агентов функция также инкапсулирует приемлемые компромиссы между достижением конфликтующих целей. (Терминология варьируется; например, некоторые агенты стремятся максимизировать или минимизировать « функцию полезности », «целевую функцию» или « функцию потерь ».)

Цели могут быть явно определены или вызваны. Если ИИ запрограммирован на « обучение с подкреплением », у него есть « функция вознаграждения », которая поощряет одни типы поведения и наказывает другие. В качестве альтернативы эволюционная система может побуждать к достижению целей, используя « функцию приспособленности » для мутации и преимущественно репликации систем ИИ с высокими показателями, подобно тому, как животные эволюционировали, чтобы врожденно стремиться к определенным целям, таким как поиск пищи. Некоторые системы искусственного интеллекта, такие как система ближайшего соседа, вместо рассуждений по аналогии, как правило, не ставят цели, за исключением той степени, в которой цели неявно присутствуют в их обучающих данных. Такие системы все еще можно тестировать, если нецелевую систему оформить как систему, «целью» которой является выполнение ее узкой классификационной задачи.

Системы, которые традиционно не считаются агентами, такие как системы представления знаний, иногда включаются в парадигму, представляя их как агентов, цель которых (например) состоит в том, чтобы отвечать на вопросы как можно точнее; понятие «действие» здесь расширено и включает в себя «действие» ответа на вопрос. В качестве дополнительного расширения системы, управляемые мимикрией, могут быть представлены как агенты, оптимизирующие «целевую функцию» в зависимости от того, насколько точно IA преуспевает в имитации желаемого поведения. В генеративных состязательных сетях 2010-х компонент «кодировщик» / «генератор» пытается имитировать и импровизировать композицию человеческого текста. Генератор пытается максимизировать функцию, инкапсулирующую, насколько хорошо он может обмануть антагонистический компонент «предсказатель» / «дискриминатор».

Хотя системы GOFAI часто принимают явную целевую функцию, парадигма также может применяться к нейронным сетям и к эволюционным вычислениям . Обучение с подкреплением может генерировать интеллектуальных агентов, которые действуют таким образом, чтобы максимизировать «функцию вознаграждения». Иногда, вместо того, чтобы устанавливать функцию вознаграждения, которая прямо равна желаемой функции оценки эталонного теста, программисты машинного обучения будут использовать формирование вознаграждения, чтобы изначально вознаграждать машину за постепенный прогресс в обучении. Ян Лекун заявил в 2018 году, что «большинство алгоритмов обучения, которые придумали люди, по сути, состоят в минимизации некоторой целевой функции». У шахмат AlphaZero была простая целевая функция; каждая победа засчитывается как +1 очко, а каждое поражение засчитывается как -1 очко. Целевая функция для беспилотного автомобиля должна быть более сложной. Эволюционные вычисления могут развить интеллектуальных агентов, которые, по-видимому, действуют таким образом, чтобы максимизировать «функцию приспособленности», которая влияет на то, сколько потомков каждому агенту разрешено покинуть.

Теоретическая и невычислимая конструкция AIXI — максимально интеллектуальный агент в этой парадигме; однако в реальном мире IA ограничен конечным временем и аппаратными ресурсами, и ученые соревнуются в создании алгоритмов, которые могут достигать все более высоких результатов в тестовых тестах с реальным оборудованием.

Классы интеллектуальных агентов

Классификация Рассела и Норвига

Рассел и Норвиг (Russell & Norvig, 2003) группируют агентов по пяти классам в зависимости от степени их предполагаемого интеллекта и способностей:

Простые рефлекторные агенты

Простой рефлекторный агент

Простые рефлекторные агенты действуют только на основе текущего восприятия, игнорируя остальную часть истории восприятия. Функция агента основана на правиле « условие-действие» : «если условие, то действие».

Эта функция агента выполняется успешно только тогда, когда среда полностью наблюдаема. Некоторые рефлекторные агенты также могут содержать информацию об их текущем состоянии, что позволяет им игнорировать состояния, исполнительные механизмы которых уже сработали.

Бесконечные петли часто неизбежны для простых рефлекторных агентов, действующих в частично наблюдаемой среде. Примечание: если агент может рандомизировать свои действия, возможно, удастся выйти из бесконечных циклов.

Рефлекторные агенты на основе моделей

Рефлекторный агент на основе модели

Агент на основе модели может обрабатывать частично наблюдаемые среды. Его текущее состояние хранится внутри агента, поддерживающего некую структуру, описывающую ту часть мира, которую нельзя увидеть. Это знание о том, «как устроен мир», называется моделью мира, отсюда и название «агент на основе модели».

Рефлекторный агент, основанный на модели, должен поддерживать какую-то внутреннюю модель, которая зависит от истории восприятия и, таким образом, отражает по крайней мере некоторые из ненаблюдаемых аспектов текущего состояния. Историю восприятия и влияние действий на окружающую среду можно определить с помощью внутренней модели. Затем он выбирает действие так же, как рефлекторный агент.

Агент также может использовать модели для описания и прогнозирования поведения других агентов в окружающей среде.

Целевые агенты

Агент на основе модели и цели

Агенты, основанные на целях, дополнительно расширяют возможности агентов на основе моделей за счет использования «целевой» информации. Информация о цели описывает ситуации, которые желательны. Это дает агенту возможность выбирать среди множества возможностей, выбирая ту, которая достигает целевого состояния. Поиск и планирование — это подполя искусственного интеллекта, предназначенные для поиска последовательностей действий, которые достигают целей агента.

Коммунальные агенты

Агент на основе модели, на основе полезности

Агенты, основанные на целях, различают только целевые состояния и нецелевые состояния. Также возможно определить меру того, насколько желательно то или иное состояние. Эта мера может быть получена с помощью функции полезности, которая отображает состояние в меру полезности состояния. Более общий показатель эффективности должен позволять сравнивать различные состояния мира в зависимости от того, насколько хорошо они удовлетворяют целям агента. Термин «полезность» можно использовать для описания того, насколько «счастлив» агент.

Агент, основанный на рациональной полезности, выбирает действие, которое максимизирует ожидаемую полезность результатов действия, то есть то, что агент ожидает получить в среднем с учетом вероятностей и полезности каждого результата. Агент на основе утилит должен моделировать и отслеживать свое окружение, задачи, которые потребовали большого количества исследований по восприятию, представлению, рассуждению и обучению.

Обучающие агенты

Преимущество обучения состоит в том, что оно позволяет агентам изначально работать в неизвестной среде и становиться более компетентными, чем могут позволить только их первоначальные знания. Наиболее важное различие заключается между «элементом обучения», который отвечает за внесение улучшений, и «элементом производительности», который отвечает за выбор внешних действий.

Элемент обучения использует обратную связь от «критика» о том, как работает агент, и определяет, как следует изменить элемент производительности или «актера», чтобы добиться лучших результатов в будущем. Элемент производительности — это то, что мы ранее считали агентом в целом: он принимает решения и принимает решения о действиях.

Последний компонент обучающего агента — «генератор проблем». Он отвечает за предложение действий, которые приведут к новому и информативному опыту.

Классификация Вайса

Вайс (2013) определяет четыре класса агентов:

- Агенты на основе логики — в которых решение о том, какое действие выполнить, принимается посредством логической дедукции;

- Реактивные агенты — в которых принятие решений осуществляется в той или иной форме прямого отображения ситуации в действие;

- Агенты убеждения-желания-намерения — в которых принятие решений зависит от манипулирования структурами данных, представляющими убеждения, желания и намерения агента; и наконец,

- Многоуровневые архитектуры — в которых принятие решений реализуется через различные программные уровни, каждый из которых более или менее явно рассуждает о среде на разных уровнях абстракции.

Иерархии агентов

Для активного выполнения своих функций интеллектуальные агенты сегодня обычно собираются в иерархическую структуру, содержащую множество «субагентов». Интеллектуальные субагенты обрабатывают и выполняют функции более низкого уровня. Взятые вместе, интеллектуальный агент и субагенты создают законченную систему, которая может выполнять сложные задачи или цели с поведением и реакциями, которые демонстрируют форму интеллекта.

Как правило, агент может быть сконструирован путем разделения тела на датчики и исполнительные механизмы, чтобы он работал со сложной системой восприятия, которая принимает описание мира в качестве входных данных для контроллера и выдает команды исполнительному механизму. Однако иерархия уровней контроллеров часто необходима для уравновешивания немедленной реакции, необходимой для задач низкого уровня, и медленных рассуждений о сложных целях высокого уровня.

Функция агента

Простая программа агента может быть определена математически как функция f (называемая «функцией агента»), которая отображает каждую возможную последовательность восприятий на возможное действие, которое может выполнить агент, или на коэффициент, элемент обратной связи, функцию или константу, которая влияет на конечные действия:

Функция агента — это абстрактное понятие, так как оно может включать в себя различные принципы принятия решений, такие как расчет полезности отдельных вариантов, дедукция по логическим правилам, нечеткая логика и т. Д.

Агент программы , вместо этого, отображает все возможные перцепции к действию.

Мы используем термин «восприятие» для обозначения восприятий, поступающих от агента в любой данный момент. На следующих рисунках агент — это все, что можно рассматривать как воспринимающее среду с помощью датчиков и воздействующее на нее с помощью исполнительных механизмов.

Приложения

Интеллектуальные агенты применяются в качестве автоматизированных онлайн-помощников , где они функционируют, чтобы воспринимать потребности клиентов с целью индивидуального обслуживания клиентов . Такой агент может в основном состоять из диалоговой системы , аватара , а также экспертной системы для предоставления пользователю определенных знаний. Их также можно использовать для оптимизации координации групп людей в сети. Hallerbach et al. обсудили применение агентных подходов для разработки и проверки автоматизированных систем вождения с помощью цифрового двойника тестируемого транспортного средства и микроскопического моделирования дорожного движения на основе независимых агентов. Waymo создала среду мультиагентного моделирования Carcraft для тестирования алгоритмов беспилотных автомобилей . Он имитирует дорожное взаимодействие между водителями-людьми, пешеходами и автоматизированными транспортными средствами. Поведение людей имитируется искусственными агентами на основе данных реального человеческого поведения. Основная идея использования агентного моделирования для понимания беспилотных автомобилей обсуждалась еще в 2003 году.

Альтернативные определения и использования

«Интеллектуальный агент» также часто используется в качестве расплывчатого маркетингового термина, иногда синонима « виртуального личного помощника ». Некоторые определения 20-го века характеризуют агента как программу, которая помогает пользователю или действует от имени пользователя. Эти примеры известны как программные агенты , а иногда «интеллектуальный программный агент» (то есть программный агент с интеллектом) упоминается как «интеллектуальный агент».

По словам Николы Касабова, системы ИА должны обладать следующими характеристиками:

- Постепенно приспосабливайте новые правила решения проблем

- Адаптация онлайн и в реальном времени

- Умеют анализировать себя с точки зрения поведения, ошибок и успеха.

- Учиться и совершенствоваться через взаимодействие с окружающей средой ( воплощение )

- Быстро учиться на больших объемах данных

- Иметь возможности для хранения и извлечения образцов на основе памяти

- Имеют параметры для представления кратковременной и долговременной памяти, возраста, забывания и т. Д.

Смотрите также

- Программный агент

- Когнитивные архитектуры

- Когнитивное радио — практическое поле для реализации

- Кибернетика , Информатика

- Агент интеллектуального анализа данных

- Воплощенный агент

- Федеративный поиск — способность агентов искать разнородные источники данных с использованием единого словаря.

- Нечеткие агенты — IA с адаптивной нечеткой логикой

- Язык программирования агента GOAL

- Интеллект

- Интеллектуальная система

- ДЖЕК Интеллектуальные агенты

- Многоагентная система и многоагентная система — несколько интерактивных агентов

- Классификация PEAS среды агента

- Обучение с подкреплением

- Семантическая сеть — предоставление данных в Интернете для автоматической обработки агентами.

- Смоделированная реальность

- Социальная симуляция

- Эра интеллектуальных агентов

Примечания

Встроенные ссылки

Другие ссылки

- Домингос, Педро (22 сентября 2015 г.). Главный алгоритм: как поиски совершенной обучающей машины переделают наш мир . Основные книги . ISBN 978-0465065707.

- Рассел, Стюарт Дж .; Норвиг, Питер (2003). Искусственный интеллект: современный подход (2-е изд.). Река Аппер Сэдл, Нью-Джерси: Prentice Hall. Глава 2. ISBN 0-13-790395-2.

- Касабов, Н. (1998). «Введение: гибридные интеллектуальные адаптивные системы». Международный журнал интеллектуальных систем . 13 (6): 453–454. DOI : 10.1002 / (SICI) 1098-111X (199806) 13: 6 <453 :: AID-INT1> 3.0.CO; 2-K .

- Вайс, Г. (2013). Мультиагентные системы (2-е изд.). Кембридж, Массачусетс: MIT Press. ISBN 978-0-262-01889-0.

внешние ссылки

- Коневральный